AIは、パーソナライズドマーケティングから自動運転車に至るまで、さまざまな分野を支えながら産業を変革しています。しかし、AIシステムが私たちの日常生活においてますます大きな影響力を持つようになるにつれ、説明責任を求める声は一層高まっています。AIが「Accountable(説明責任を果たす)」であるとはどういう意味なのでしょうか。また、それはなぜ重要なのでしょうか。

本ブログでは、AIにおける説明責任の本質的な意味を考察するとともに、この分野においてPatsnapがどのように重要な役割を果たしているのかを解説します。

Accountable AIとは何でしょうか

Wharton Business SchoolのKevin Werbach教授によると、Accountable AIとは、AIが適切に統治されることを確保し、責任ある、安全かつ信頼できる利用を促進するために、技術的・運用的・法的な仕組みを実装することを意味します。

なぜ説明責任は重要なのでしょうか

ここでは、説明責任がなぜ不可欠であるのかを示すいくつかの観点を取り上げます。

信頼:ユーザーおよびステークホルダーは、AIシステムが公正であり、信頼性が高く、安全であると信頼できる必要があります。

倫理:AIはバイアスを増幅させたり、不透明な意思決定を行ったりする可能性があります。説明責任は、倫理的基準が遵守されることを確保します。

規制:各国政府および産業界は、組織に対して責任あるAIの実践を示すことを求める規制(EU AI Actなど)を導入しています。

リスクマネジメント:Accountable AIは、法務、レピュテーション、オペレーションに関するリスクを特定し、軽減し、対応するうえで組織を支援します。

Accountable AIの主要原則

Accountable AIは、システムが有効であるだけでなく、倫理的であり、透明性があり、信頼できるものであることを確保します。AIシステムは説明可能であるべきであり、ユーザーは意思決定がどのように、そしてなぜ行われたのかという根拠を理解できる必要があります。

AIは孤立した環境で動作しているわけではありません。すべてのアルゴリズムの背後には、開発者、データサイエンティスト、意思決定者のチームが存在します。責任とは、AIシステムおよびその結果に対して明確なオーナーシップが存在することを意味します。医療における誤診であれ、採用アルゴリズムにおけるバイアスであれ、誰かが説明責任を負い、是正措置を講じる権限を持っていなければなりません。AIシステムはデータから学習し、その結果として社会的バイアスを反映する可能性があります。適切なセーフガードがなければ、AIは採用、融資、警察活動などの分野における差別を強化する可能性があります。公正性とは、バイアスを検出し、軽減するようにシステムを積極的に設計することを意味します。

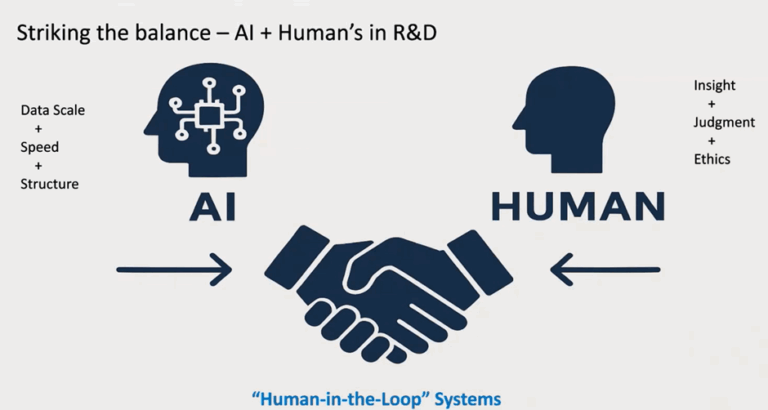

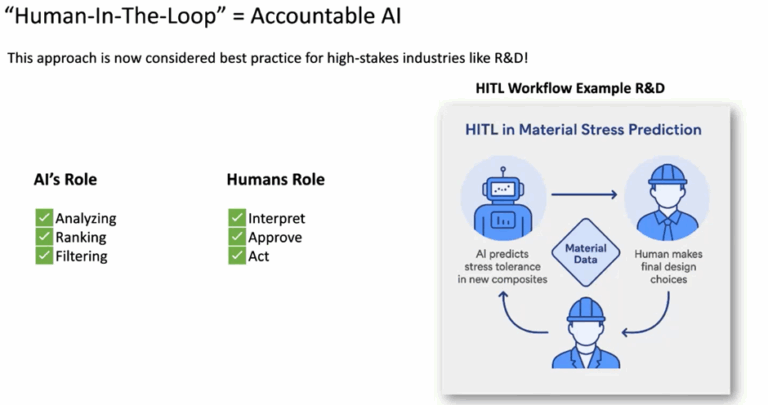

Human-in-the-Loop:PatsnapがどのようにAccountable AIを構築し、ユーザーに主導権をもたらすか

AI導入をめぐる競争においては、しばしばスピードが注目を集めます。しかしPatsnapでは、真のイノベーションとは単に速く進むことではなく、より深く考え、より賢明に行動し、そして主導権を維持することであると考えています。

そのため、私たちはHuman-in-the-Loopの原則を推進しています。それは単なる技術的フレームワークではなく、一つのマインドセットです。すなわち、AIが人に取って代わるのではなく、人と協働することを確実にする考え方です。

「Human-in-the-Loopとは、あらゆる意思決定、あらゆる洞察、あらゆる行動の中心に常にユーザーが位置することを意味します。AIは有力な回答候補を生成することができますが、それらの結果を検証し、次に何を行うかを決定するのは、ユーザーの専門知識、直感、そして判断力です。」

Patsnapでは、この原則がツールおよびワークフローの設計に反映されています。入力内容の確認、出力結果の解釈、そして結果の検証に至るまで、ユーザーが完全なコントロールを有します。これは、AIをブラックボックスではなく思考のパートナーとすることを可能にします。なぜなら、私たちはAIは人間の知性を拡張するものであり、置き換えるものではないと考えているからです。

AIが企業、マーケット、そして人々の生活に影響を及ぼす意思決定をますます担う世界においては、責任が重要になります。Human-in-the-Loopは透明性と説明責任を確保し、信頼を創出します。このアプローチは、公正性、監査可能性、是正措置をすべてのシステムに組み込むという、私たちのAccountable AIへの広範な取り組みとも一致しています。

今後の展望

Accountable AIは単なる技術的課題ではなく、文化的および組織的な課題でもあります。AIが進化を続ける中で、説明責任を優先する企業は、規制を遵守するだけでなく、顧客やコミュニティとのより強固で信頼性の高い関係を構築することができます。